التقرير السنوي لعام 2023 يوضح تأثير المجلس على شركة Meta

تم النشر بتاريخ 27 حَزِيران 2024

لقد كان عام 2023 يمثل عامًا من التأثير والابتكار بالنسبة للمجلس. واستمرت توصياتنا في تحسين كيفية تجربة الأشخاص لمنصات Meta وعالجنا -من خلال نشر المزيد من القرارات بأشكال جديدة- المزيد من الأسئلة الأكثر صعوبة المتعلقة بالإشراف على المحتوى أكثر من أيّ وقت مضى.

تنفيذ شركة Meta لتوصياتنا يكتسب زخمًا متزايدًا. يُظهر تقريرنا السنوي لعام 2023 أنه في الفترة ما بين يناير 2021، عندما نشرنا قراراتنا الأولى، ومايو 2024 عندما تم الانتهاء من هذا التقرير، قامت Meta بتنفيذ 75 توصية من توصياتنا كليًا أو جزئيًا، وأبلغت عن إحراز تقدم في تنفيذ 81 توصية أخرى. الأرقام، بطبيعة الحال، لا تخبر بالقصة بأكملها؛ إن ما يهم هو جودة التوصيات وتأثيرها.

تقديم النتائج إلى مستخدمي موقعي Facebook وInstagram

المشكلة المستمرة هي أن المستخدمين غالبًا ما يُتركون في حالة تخمين حول سبب قيام Meta بإزالة المحتوى الخاص بهم أو تعليق حساباتهم.

ولمعالجة هذه المشكلة، ناشدنا Meta بضرورة الالتزام بمبادئ الشفافية التالية: جعل قواعدك سهلة الفهم، وإبلاغ الأشخاص عن كيفية تنفيذها، وعندما يخالف الأشخاص قواعدك، وجوب إخبارهم بالأخطاء التي فعلوها على وجه التحديد.

في 2022، استجابةً لتوصياتنا، قدمت شركة Meta رسائل جديدة تخبر الأشخاص بالسياسة المحددة التي انتهكوها في سياسات الخطاب الذي يحض على الكراهية، والمنظمات الخطرة والأفراد الخطرين، والتنمر والإساءة.

وفي عام 2023، استمرت توصياتنا في تحسين تجارب الأشخاص على Facebook وInstagram.

يُظهر التقرير السنوي الصادر اليوم كيف أن Meta، استجابةً لتوصيات المجلس:

- أطلقت حالة الحساب، وهي تجربة داخل المنتج تخبر الأشخاص بالعقوبات الحالية والسابقة التي يتم فرضها على حساباتهم، وسبب تطبيق شركة Meta للعقوبة.

- قامت بتحسين نظام "الإنذارات" لديها لشرح سبب إزالة محتوى شخص ما وآلية عمل النظام، بالإضافة إلى جعله أكثر إنصافًا للمستخدمين الذين تأثروا بشكل غير متناسب في الماضي.

- بدأت في تحذير الناس إذا كان هناك احتمال كبير أن تمثل منشوراتهم انتهاكًا، ما يمنحهم فرصة لحذف المحتوى الخاص بهم ونشره مرة أخرى. وعلى مدار فترة تبلغ 12 أسبوعًا في 2023، أصدرت Meta تحذيرات بشأن 100 مليون عنصر من عناصر المحتوى.*

لقد نقلنا هذا الزخم إلى عام 2024، مع توصياتنا بزيادة تحسين طريقة تعامل Meta مع الأشخاص الذين يستخدمون منصاتها.

وغالبًا ما يخبرنا الأشخاص أن Meta قد حذفت منشورات تلفت الانتباه إلى خطاب يحض على الكراهية لأغراض الإدانة أو السخرية أو التوعية بسبب عدم قدرة الأنظمة الآلية (وأحيانًا المراجعين البشريين) على التمييز بين هذه المنشورات والخطاب الذي يحض على الكراهية نفسه. ولمعالجة هذا الأمر، طلبنا من Meta إنشاء طريقة ملائمة للمستخدمين حتى يوضحوا في طعونهم أن منشوراتهم تندرج تحت إحدى هذه الفئات. وقد وافقت Meta على ذلك واليوم نصدر بيانات جديدة عن تأثيره.

- وفي فبراير 2024، تلقت Meta أكثر من سبعة ملايين من الطعون من أشخاص تمت إزالة محتواهم بموجب قواعدها المتعلقة بالخطاب الذي يحض على الكراهية. وقد اختار ثمانية من أصل 10 من مقدمي الطعون استخدام هذا الخيار الجديد لتوفير سياق إضافي. وقد أشار واحد من كل خمسة من هؤلاء المستخدمين إلى أن الهدف من المحتوى الخاص به كان "زيادة الوعي"، بينما اختار واحد من كل ثلاثة مستخدمين "كان ذلك على سبيل المزاح". نحن نؤمن بأن إعطاء الناس صوتًا - والاستماع إليهم - يمكن أن يساعد Meta على اتخاذ قرارات أفضل.*

- وفي مايو 2024، واستجابةً لتوصياتنا، بدأت Meta في تصنيف مجموعة أكبر من محتوى الفيديو والصوت والصور على أنه "مصنوع باستخدام الذكاء الاصطناعي." سيوفر هذا للأشخاص سياقًا وشفافيةً أكبر لأنواع أكثر من وسائل الإعلام التي يتم التلاعب بها، مع إزالة المنشورات التي تنتهك قواعد Meta بطرق أخرى.

حماية الخطاب والمحافظة عليه

كما ساعدت توصياتنا Meta في حماية وحفظ المحتوى الخاص بالاحتجاجات والظروف الصحية والأعمال الوحشية التي حدثت أثناء النزاعات.

يُظهر تقريرنا السنوي لعام 2023 كيف أن Meta، استجابةً لتوصيات المجلس:

- سمحت باستخدام المصطلح "Marg bar Khamenei" (والذي يُترجم حرفيًا إلى "الموت لـ [المرشد الأعلى لإيران] خامنئي") في سياق الاحتجاجات في إيران. بعد أن طبّقت Meta هذه التوصية في يناير 2023، أظهرت عينة من الحسابات على Instagram أن المنشورات التي تستخدم هذا المصطلح زادت بنسبة 30% تقريبًا - لحماية الخطاب السياسي في إيران.

- قامت بتحديث وإنشاء مصنفات جديدة، والتي منعت -على مدار فترتين مدة كل منهما 30 يومًا في 2023، الإزالة التلقائية لإجمالي 3,500 عنصر من عناصر المحتوى المتعلق بسرطان الثدي. وهذا يحمي المحتوى المهم من مريضات سرطان الثدي والناشطين في مجال سرطان الثدي.

- تضع الصيغة النهائية لنهج جديد ومتناسق للحفاظ على الأدلة المحتملة على الفظائع والانتهاكات الخطيرة للقانون الدولي لحقوق الإنسان والقانوني الدولي الإنساني.

نشر المزيد من الحالات، بشكل أسرع

لقد كان عام 2023 مليئًا بالابتكارات. وعقب التزامنا بنشر المزيد من الحالات، بصورة أسرع، أصدرنا قراراتنا الموجزة الأولى التي تدرس الحالات التي قامت فيها شركة Meta بتغيير قرارها الأصلي المتعلق بعنصر من المحتوى بعد أن تم إدراجه في القائمة المختصرة للمراجعة المحتملة. كما أصدرنا أيضًا أولى قراراتنا العاجلة، والتي كانت تدور حول الصراع بين إسرائيل وحماس.

وبالإضافة إلى ذلك، نشرنا قرارات قياسية في مجالات جديدة تشمل أسرى الحرب، الأنظمة الغذائية القاسية والخطاب الذي ينطوي على عنف الذي يستهدف الأشخاص المتحولين جنسيًا. وإجمالاً لذلك، فإننا اتخذنا قراراتٍ في 53 قضية في عام 2023، وهذا أكثر من أيّ عام سابق، وألغينا قرار Meta الأصلي في حوالي 90% من الحالات.

مع 47 قضية تم البت فيها أو الإعلان عنها حتى الآن في عام 2024، نحن في الطريق الصحيح لتجاوز إجمالي العام الماضي. وتشمل هذه الحالات مواضيع مهمة للإشراف على المحتوى مثل التزييف العميق الصريح الذي ينشئه الذكاء الاصطناعي وإنكار الهولوكوست وانتقاد رؤساء الدول.

وفي فبراير، قمنا أيضًا بتوسيع نطاق عملنا ليشمل تطبيق Threads - وهي المرة الأولى التي نتعامل فيها مع تطبيق جديد - وأعلنّا عن أول حالة من حالات تطبيق Threads في مايو. لقد شهدنا أيضًا زيادة في المشاركة في عملنا، مع تقديم 2800 تعليق عام على القضايا المنشورة أو المعلنة هذا العام - حوالي ضعف العدد الذي تلقيناه في عامي 2022 و2023 مجتمعين.

التطور لتوسيع نطاق نفوذنا

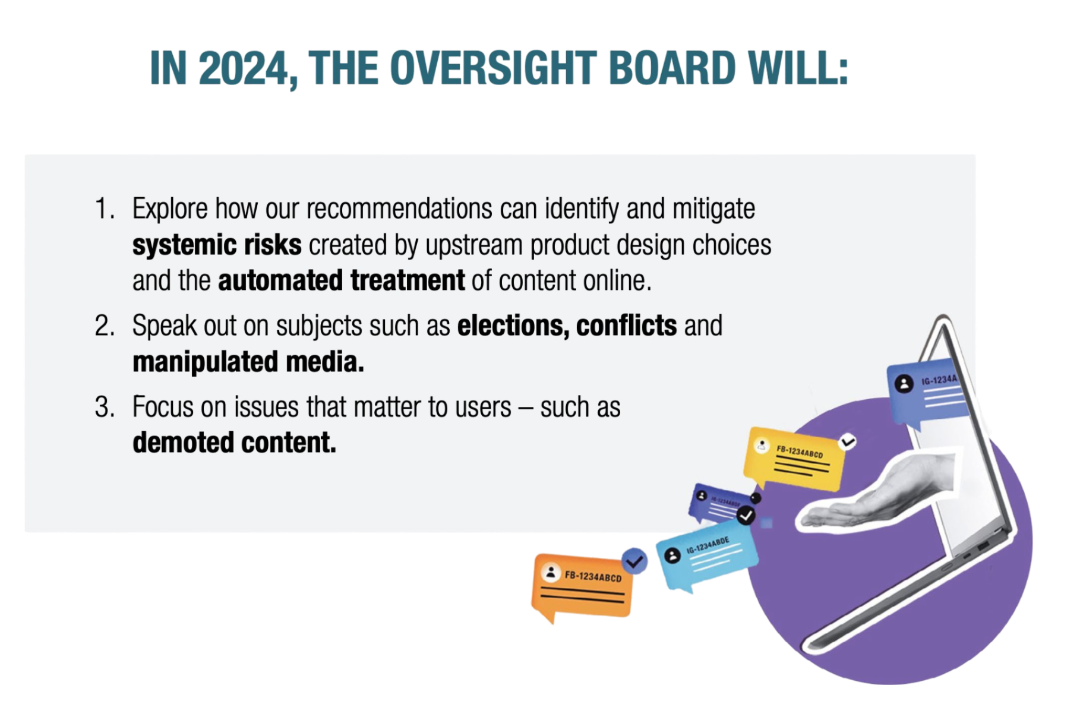

وعلى الرغم من أننا قطعنا شوطًا طويلاً، إلا أننا نبتكر أيضًا لنكون أكثر ارتباطًا بأكبر المناقشات في مجال الإشراف على المحتوى. في عام 2024، على سبيل المثال، سنقوم بنشر مستندات تقنية تبحث في قضايا واسعة النطاق تواجه وسائل التواصل الاجتماعي استنادًا إلى الخبرة المكتسبة من مجموعة أعمالنا الكاملة، بدلاً من مجرد حالات محددة.

ومع ذهاب نصف سكان العالم تقريبًا إلى صناديق الاقتراع هذا العام، أصدرنا أول مستند تقني حول الانتخابات يتضمن تسعة دروس رئيسية للصناعة. وفي الأسابيع المقبلة، سننشر مستندنا التقني التالي حول الذكاء الاصطناعي والأتمتة.

وبينما ننتقل إلى عام 2024، نريد أن ندرس القضايا الرئيسية الأخرى التي تهم المستخدمين، مثل المحتوى الذي انخفض تصنيفه. كما أننا نولي اهتمامًا للمشهد التنظيمي المتغير وأهمية نموذج المجلس - وهو هيئة تداولية عالمية مستقلة تعمل على فحص الحالات من منظور حقوق الإنسان.

في الآونة الأخيرة، وكجزء من جهودنا المستمرة لتحسين تجارب المستخدمين، عملنا مع Meta لجعل عملية تقديم الطعون لدينا أكثر سهولة. وبالإضافة إلى ذلك، وبعد أن أطلقنا موقعنا الإلكتروني الجديد في شهر مايو، فإننا نجري تغييرات على تقارير الشفافية لدينا. ويتضمن موقعنا الإلكتروني الجديد الآن الكثير من المحتوى الذي نشرناه في تقارير الشفافية ربع السنوية، ومؤخرًا نصف السنوية، بما في ذلك متتبع تفاعلي لتوصياتنا، وأرشيف التعليقات العامة والقدرة على تصفية القرارات حسب البلد والمنطقة ومعيار المجتمع. وعلى هذا النحو، بينما سنستمر في نشر التقارير السنوية، فإننا لن نصدر تقارير نصف سنوية بعد الآن.

وبعد مرور أربع سنوات على رحلتنا، ما زلنا نتعامل مع أصعب الأسئلة في مجال الإشراف على المحتوى وندفع Meta إلى معاملة المستخدمين بنزاهة. إن التحدي كبير، وحالة عدم اليقين عظيمة، ولكن العمل الذي نقوم به مهمًا حقًا. وسنسعى جاهدين معًا للعثور على الإجابات التي تُحسن التواصل الاجتماعي للأشخاص في جميع أنحاء العالم.

لمعرفة المزيد عن تقارير الشفافية لدينا، انقر هنا.

* تُرجى الملاحظة: تُجمع جميع المعلومات ويتم إلغاء هوياتها لحماية خصوصية المستخدم. تُعدّ جميع المقاييس تقديرات، تعتمد على أفضل المعلومات المتاحة لفترة زمنية محددة.